摘要:本文关注深度学习模型的改进与创新,探索前沿技术与策略的应用。通过深入研究现有模型,对其性能进行优化提升,同时结合最新技术趋势,如神经网络架构创新、优化算法等,以推动深度学习领域的发展。本文旨在分享模型改进的方法和策略,为相关领域的研究者和技术爱好者提供有价值的参考。

本文目录导读:

随着人工智能技术的飞速发展,深度学习已成为许多领域的关键技术,深度学习模型在许多问题上取得了显著的成果,但仍然存在一些挑战和待改进之处,本文旨在探讨深度学习模型的改进策略与技术,以期提高模型的性能、效率和泛化能力。

深度学习模型概述

深度学习模型是一种基于神经网络的学习方法,通过模拟人脑神经元的连接方式,实现复杂数据的处理与分析,深度学习模型包括卷积神经网络(CNN)、循环神经网络(RNN)、生成对抗网络(GAN)等,这些模型在图像识别、语音识别、自然语言处理等领域取得了显著成果。

深度学习模型面临的挑战

尽管深度学习在许多领域取得了巨大成功,但仍面临一些挑战和待解决的问题,其中包括:

1、模型性能:在某些复杂任务上,现有模型的性能仍有限,如何提高模型的性能,使其更好地处理复杂数据是一个关键问题。

2、模型效率:深度学习模型的训练需要大量的计算资源和时间,提高模型的训练效率,降低计算成本是一个亟待解决的问题。

3、泛化能力:深度学习模型在解决新问题时往往表现出泛化能力不足的问题,如何提高模型的泛化能力,使其更好地适应新环境是一个重要课题。

深度学习模型的改进策略与技术

针对以上挑战,本文提出以下深度学习模型的改进策略与技术:

1、模型结构优化

模型结构优化是提高深度学习模型性能的关键途径,通过改进网络结构、引入新的层类型或调整参数,可以提高模型的性能,残差网络(ResNet)通过引入残差块,解决了深度神经网络训练过程中的梯度消失问题,提高了模型的性能。

2、模型压缩与加速

为了提高深度学习模型的训练效率,降低计算成本,模型压缩与加速成为了一个研究热点,模型压缩技术可以通过量化、剪枝、蒸馏等方法减小模型的大小,提高模型的运行效率,模型加速技术,如硬件加速和算法优化,也可以显著提高模型的运行速度和效率。

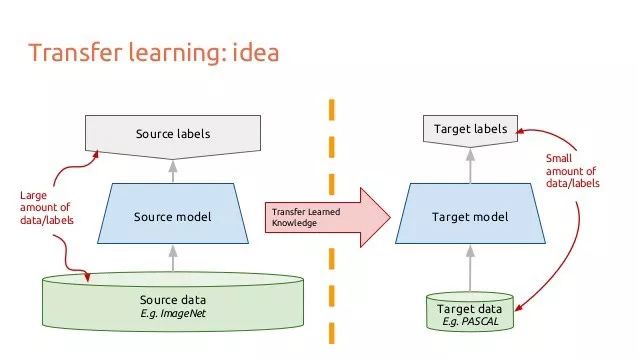

3、迁移学习与预训练模型

迁移学习是提高深度学习模型泛化能力的一种有效方法,通过在大规模数据集上预训练模型,然后将预训练模型应用于特定任务,可以提高模型的性能,近年来,预训练模型如BERT、GPT等在自然语言处理领域取得了显著成果,通过迁移学习,这些预训练模型可以在各种任务上实现快速适应和良好性能。

4、自适应学习与终身学习

自适应学习和终身学习是提高深度学习模型适应新环境能力的关键途径,自适应学习通过在线调整模型参数,使模型能够适应不断变化的数据分布和任务需求,终身学习则通过记忆回放、元学习等技术,使模型能够在多个任务之间迁移和积累知识,实现持续学习,这些技术有助于提高模型的泛化能力和适应性,使其更好地应对复杂多变的环境。

5、集成学习方法

集成学习方法通过将多个模型的预测结果进行组合,以提高模型的性能和稳定性,常见的集成学习方法包括Bagging、Boosting和Stacking等,在深度学习模型中,可以通过集成多个不同结构的神经网络,或者结合传统机器学习方法与深度学习模型,来提高模型的性能。

本文探讨了深度学习模型的改进策略与技术,包括模型结构优化、模型压缩与加速、迁移学习与预训练模型、自适应学习与终身学习以及集成学习方法,这些技术有助于提高深度学习模型的性能、效率和泛化能力,为人工智能领域的发展提供有力支持,随着技术的不断进步,我们期待深度学习模型能够在更多领域取得突破和应用。